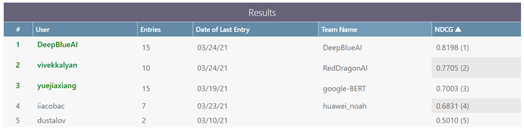

冠軍方案 | 深蘭科技包攬 ICCV2021 無人機挑戰賽雙冠軍

2021-10-1410月11日至10月17日,2021國際計算機視覺大會International Conference on Computer Vision (ICCV)于線上拉開序幕。此次會議,深蘭科技DeepBlueAI團隊共參加2項比賽4個賽道,分別在VisDrone Object Detection,VisDroneMot,Large-AI-Food三個賽道獲得冠軍。VisDrone 已成為無人機領域標桿數據集,且業界多篇論文在此數據集基礎上研究發表。

本次無人機挑戰賽吸引來自全球多家知名團隊參與角逐,其中不乏多所高校與頂級技術團隊,包括清華大學、中科院計算所、北京郵電大學、騰訊、谷歌等上百支知名團隊參賽。以下主要分享在無人機挑戰賽中兩個賽道的方案解讀。

冠軍方案解讀

本次挑戰賽深蘭團隊包攬兩個賽道的冠軍:

●任務1:圖像中的目標檢測。任務旨在從無人機拍攝的單個圖像中檢測預定義類別的對象(例如,汽車和行人);

●任務 2:多目標跟蹤挑戰。該任務旨在恢復每個視頻幀中對象的軌跡。

VisDrone Object Detection 方案解讀

挑戰賽官網地址:http://aiskyeye.com/

VisDrone數據集由天津大學機器學習與數據挖掘實驗室 AISKYEYE 隊伍負責收集,全部基準數據集由無人機捕獲,包括 288 個視頻片段,總共包括 261908 幀和 10209 個靜態圖像。

這些幀由 260 多萬個常用目標(如行人、汽車、自行車和三輪車)的手動標注框組成。為了讓參賽隊伍能夠更有效地利用數據,數據集還提供了場景可見性、對象類別和遮擋等重要屬性。

VisDrone Object Detection 賽道獲獎證書

據DeepBlueAI團隊介紹,雖然該比賽已舉辦多屆,仍然存在以下幾個難點:

1. 大量的檢測物體

2. 部分目標過小

3. 不同的數據分布

4. 目標遮擋嚴重

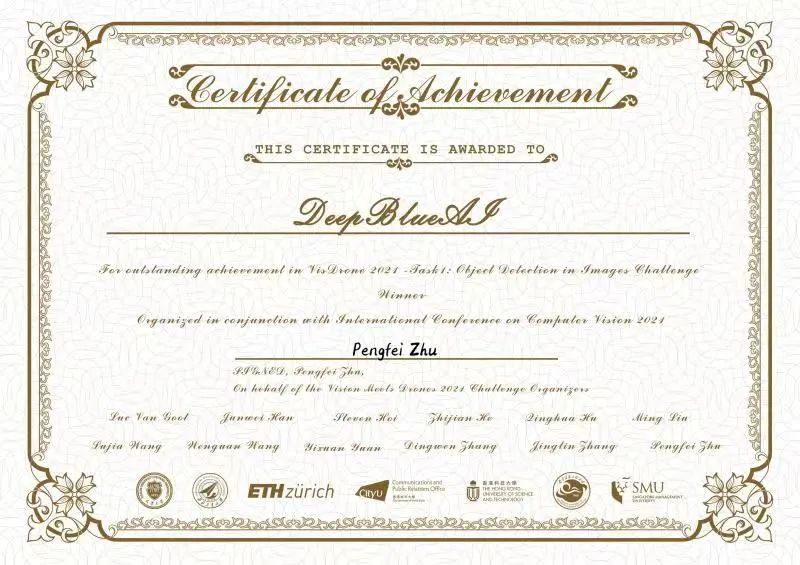

數據分布

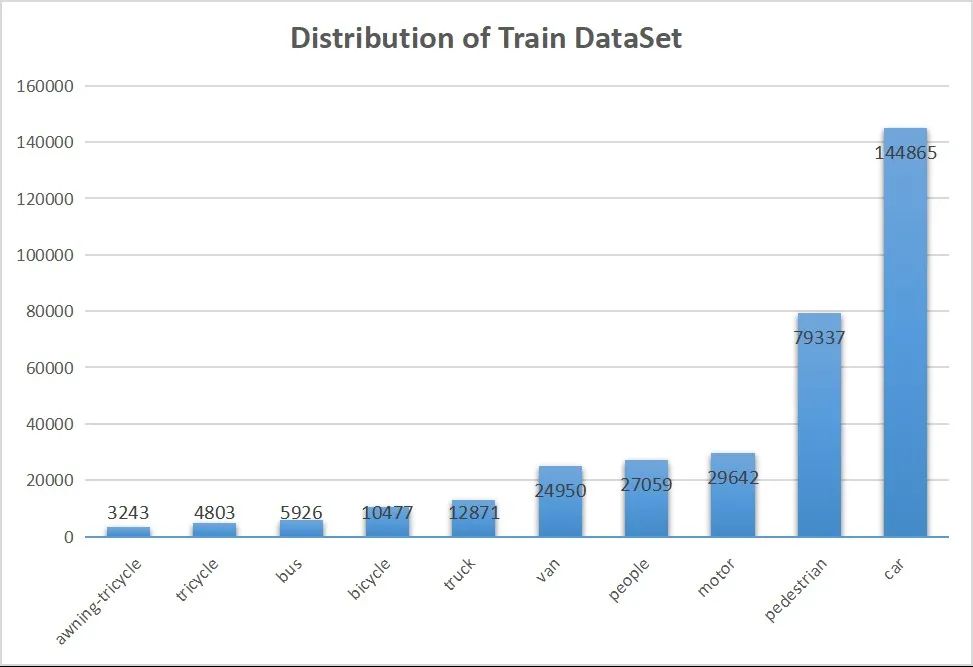

遮擋數據量統計

針對數據集難點,DeepBlueAI團隊設計了一套強有力的數據增強方式和pipeline。

數據處理

1、數據平衡

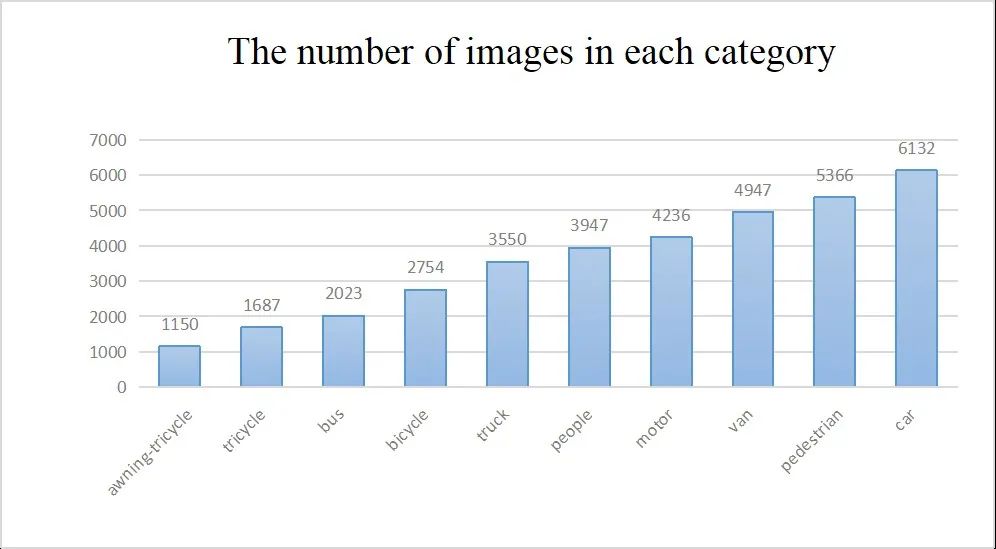

上圖為每一類數據在訓練集中的數量(舉例:6471張訓練集中,有1150張包含awining-tricycle這個類),將每一類圖片數量小于4000張的,通過隨機加噪聲、改變亮度、cutout等方式擴充為4000張,以緩解類別不平衡的問題。

2、中心裁剪

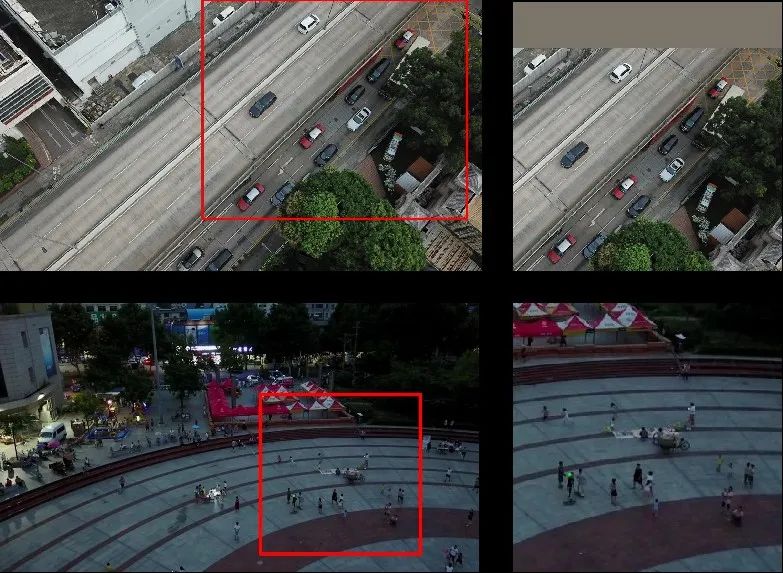

用中心裁剪的方式,隨機在原圖上裁剪320~960大小的區域,然后把它們resize為相近的尺度,以緩解目標尺度不一致的問題。上面第一行是在原圖中切了960×960大小,第二行是切了320×320大小,把它們resize到同一個尺度(如640×640),相當于達到了小目標放大、大目標縮小的目的。并且對于邊界目標是全保留的策略。

3、馬賽克增強

馬賽克數據增強將4張訓練圖像按一定比例組合成1張,豐富了檢測數據集, 增加了很多小目標。Mosaic是YOLOv4中引入的第一個新的數據增強技術。這使得模型能夠學習如何識別比正常尺寸小的物體。它還鼓勵模型在框架的不同部分定位不同類型的圖像。通過縮放,以及一次計算4 張圖片,充分利用了 GPU 資源,使得 batch_size 不用很大就能達到很好的效果。

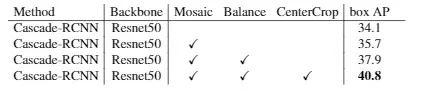

消融實驗:數據處理帶來了很大的收益

PipeLine

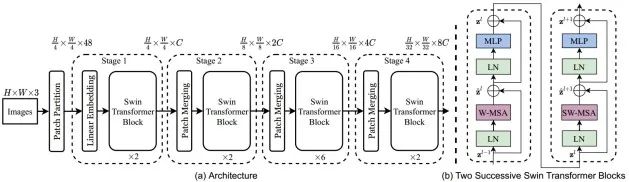

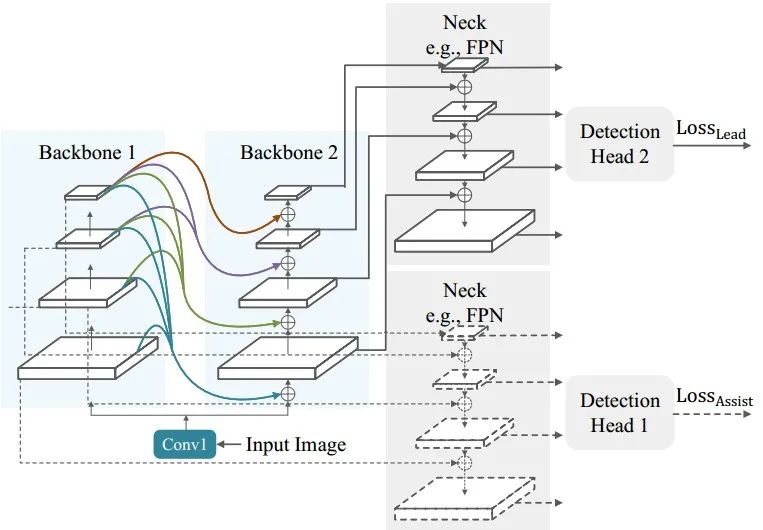

Swin-Transformer+ CBNet + Cascade RCNN + DCN + FPN

Cbnetv2體系結構將多個相同的主干網分組,這些主干網通過復合連接進行連接,可以在不增加額外成本的情況下獲得良好的效果。

Swin-Trainsformer作為計算機視覺領域的強有力的backbone之一,扮演著越來越重要的角色。當DeepBlueAI團隊用swin-Transformer系列替換主干時,線上結果得到了極大的改善。

后處理

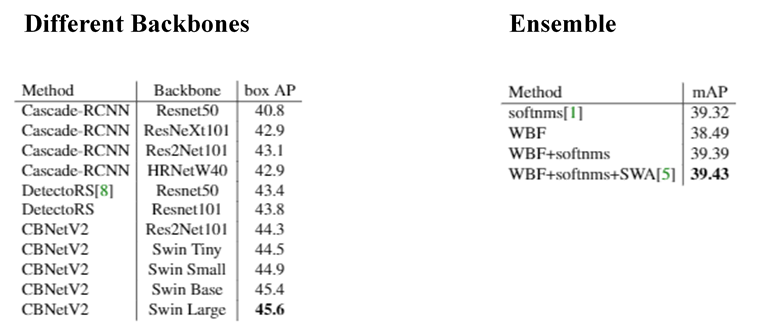

1)soft nms + WBF,根據預測的score分段集成的,大于等于0.1用WBF,小于0.1用soft_nms。目的是既可以提高高分框的定位精度,增加召回從而提升mAP;

2)模型集成,使用不同backbone以及pipeline訓練。

消融實驗結果

本文針對Visdrone挑戰賽設計了一套解決方案包括數據處理,檢測器和軌跡后處理,DeepBlueAI團隊表示:“很榮幸在Visdrone 2021取得第一名的成績”。同時團隊也在多目標跟蹤賽道取得了不錯的成績,接下來會介紹MOT相關技術內容。

VisDrone MOT 方案解讀

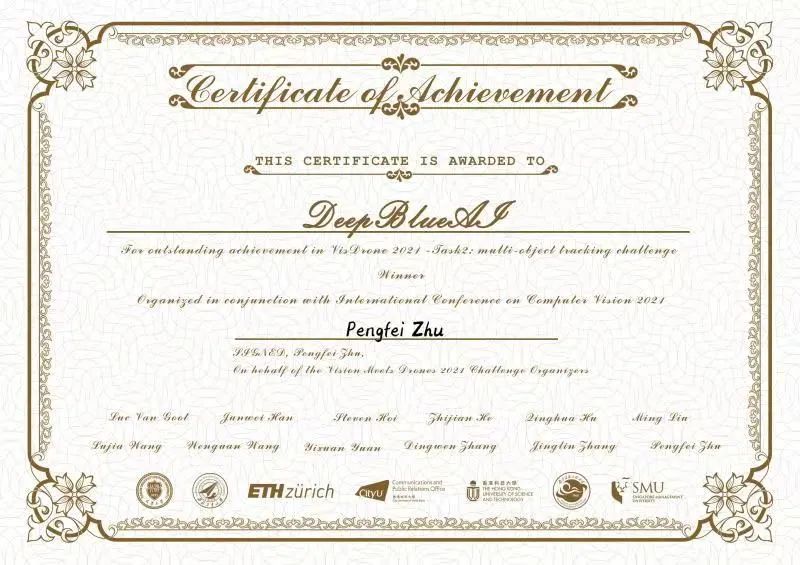

VisDrone Mot 賽道獲獎證書

Pipeline

對于同一挑戰賽的MOT賽道,DeepBlueAI團隊也總結了相關難點并設計出一套相關的pipeline。

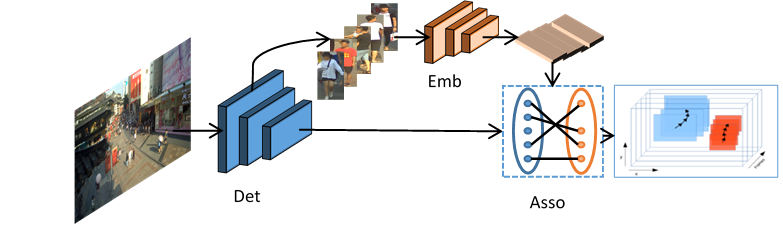

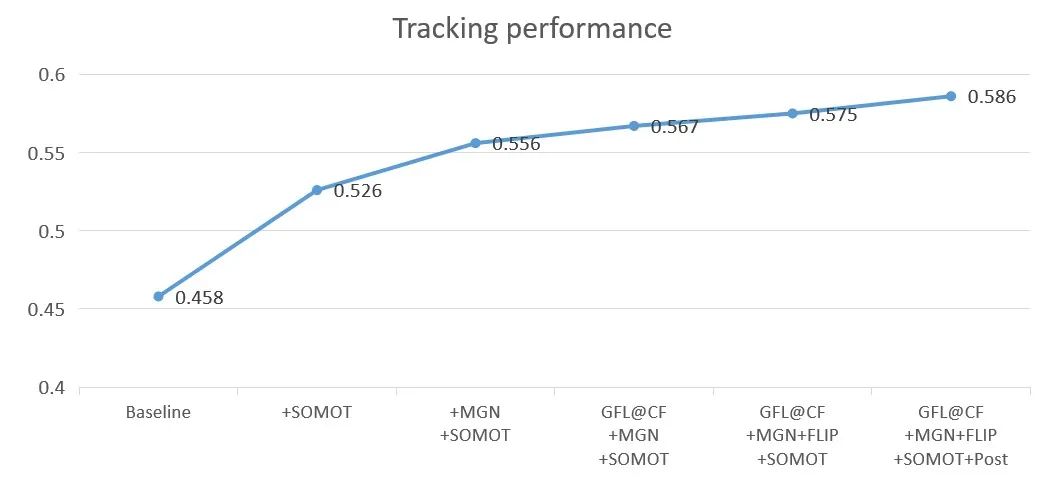

本次采用的多目標跟蹤系統是DeepBlueAI團隊長時間以來總結的一套比較好的pipeline,在競賽中多次取得不錯的成績,基于Detection和Embedding分離的方法,團隊采用了以GeneralizedFocal Loss(GFL)為損失的anchor-free檢測器,并以MultipleGranularity Network (MGN)作為Embedding模型。在關聯過程中,DeepBlueAI團隊借鑒了DeepSORT和FairMOT的思想,構建了一個簡單的在線多目標跟蹤器。

Detector

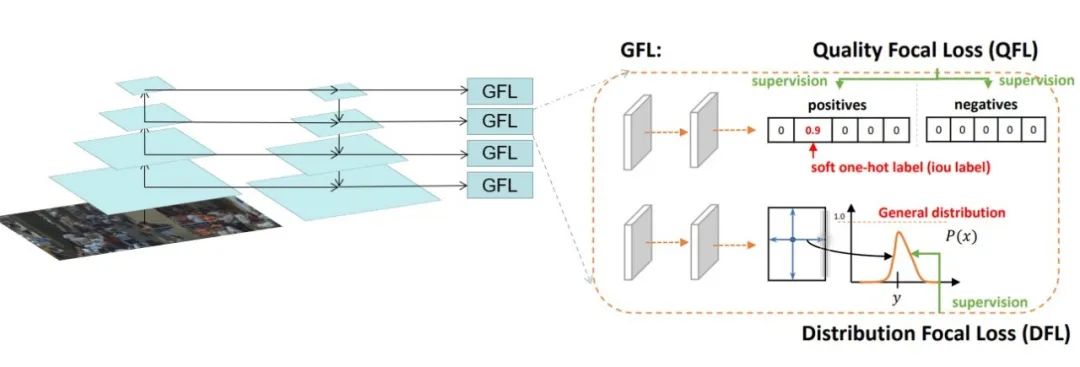

對于檢測器DeepBlueAI團隊使用了GFLDetector、Generalized Focal Loss(GFL),更具體的來說,GFL可以分成QualityFocal Loss(QFL)以及Distribution Focal Loss(DFL)。

QFL專注于asparse set of hard examples,同時在相應的類別上產生它們的連續0~1之間的localizationquality estimation;DFL使網絡能夠在任意和靈活的分布下,學習bounding boxes在連續位置上的概率值。

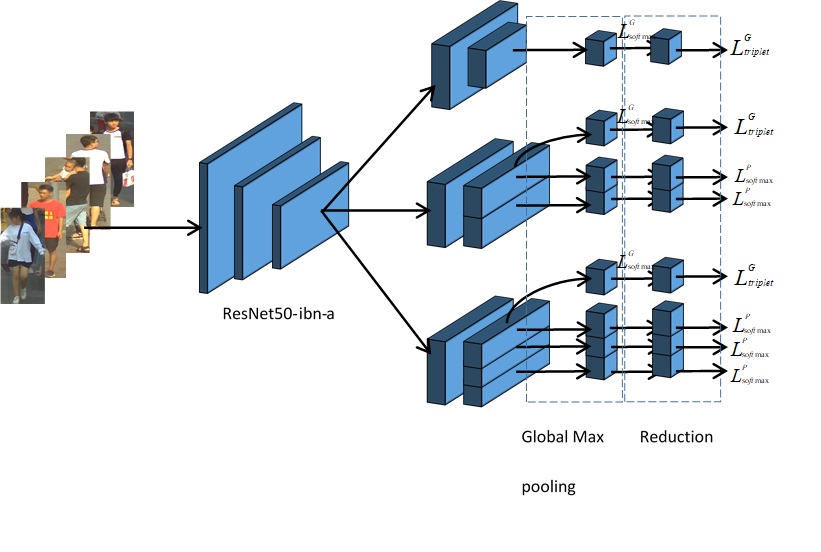

Embedding

MGN把全局和局部的特征結合在一起,能夠有豐富的信息和細節去表征輸入圖片的完整情況。在觀察中發現,確實是隨著分割粒度的增加,模型能夠學到更詳細的細節信息,全局特征跟多粒度局部特征結合在一起,思路比較簡單,全局特征負責整體的宏觀上大家共有的特征的提取,然后把圖像切分成不同塊,每一塊不同粒度,它去負責不同層次或者不同級別特征的提取。

Data Association

DeepBlueAI團隊借鑒了DeepSORT和FairMOT的想法,以檢測框的表觀距離為主,以檢測框的空間距離為輔。首先,根據第一幀中的檢測框初始化多個軌跡。在隨后的幀中,團隊根據embedding features之間的距離(最大距離限制為0.7),來將檢測框和已有的軌跡做關聯。與FairMOT一致,每一幀都會通過指數加權平均更新跟蹤器的特征,以應對特征變化的問題。對于未匹配的激活軌跡和檢測框通過他們的IOU距離關聯起來(閾值為0.8)。最后,對于失活但未完全跟丟的軌跡和檢測框也是由它們的IoU距離關聯的(閾值為0.8)。

Post Process

由于只有較高的置信度的檢測框進行跟蹤,因此存在大量假陰性的檢測框,導致MOTA性能低下。為了減少置信閾值的影響,DeepBlueAI團隊嘗試了兩種簡單的插值方法。

1) 對總丟失幀不超過20的軌跡進行線性插值。我們稱之為簡單插值(simple interpolation, SI)。

2)對每一個軌跡只在丟失不超過4幀的幀之間插入。另外,DeepBlueAI團隊稱之為片段插值(fragment interpolation,FI)。

Result

Conclusion

DeepBlueAI團隊設計了一個簡單、在線的多目標跟蹤系統,包括檢測器、特征提取、數據關聯和軌跡后處理,最終在VisDrone 2021 MOT賽道斬獲冠軍。

-

8項冠亞季軍收官ECCV2020,深蘭獲三大視覺頂會挑戰賽大滿貫

計算機視覺 -

與騰訊、哈工大同臺競技,深蘭獲自然語言處理領域國際頂會NAACL2021冠軍

計算機視覺 -

捷報 | 深蘭科技“雙隊”出征CVPR2021 斬獲五冠共獲14項大獎

計算機視覺 -

2022CVPR傳捷報丨深蘭科技再度折桂,連續4屆獲得CVPR挑戰賽冠軍

計算機視覺 -

深蘭科技奪冠CCKS2022“帶條件的分層級多答案問答”評測任務競賽

自然語言處理 -

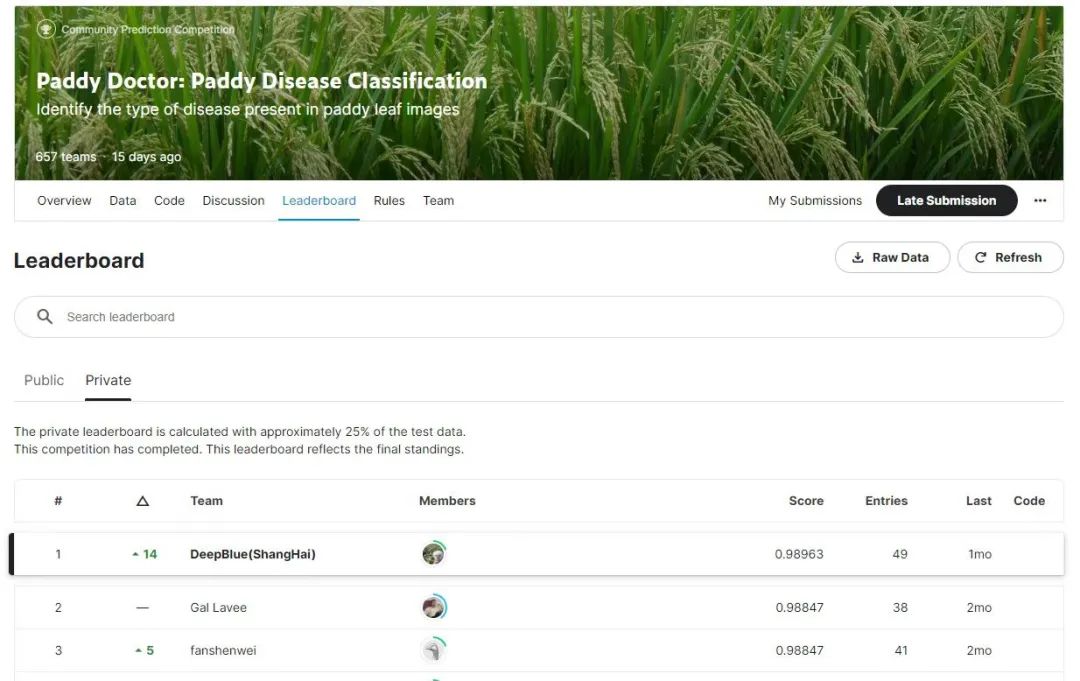

PK 656 個對手!深蘭科技在全球頂級AI賽事kaggle競賽中再次奪冠

計算機視覺 -

一冠三亞二季!深蘭科技在EMNLP2022國際頂級賽事再創佳績

數據挖掘 -

6個獎項!深蘭科技在CVPR 2023挑戰賽中再獲佳績

計算機視覺 -

6冠3亞2季!深蘭科技在RANLP2023國際賽事上斬獲11項大獎

計算機視覺